Сразу предупрежу, что далее я описываю конкретное (одно) решение снятия нагрузки на сервер. Оно может как помочь, так и быть бесполезным в вашем случае…

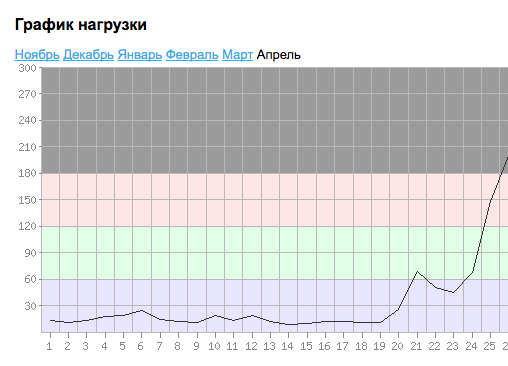

Получил недавно письмо от своего хостинг-провайдера о том, что мой аккаунт генерирует нагрузку на сервер. В админке аккаунта было следующее:

И вряд ли мои сайты стали за пару дней такими популярными. Бонусом из письма было предложение перейти на новый тариф, либо отключить меня в связи с нарушением п. 2.11 Приложения № 1 к Оферте. Последнее меня больше всего напрягло, т.к. на моем аккаунте лежит не один десяток сайтов и я вообще понятия не имею какой из них мог так мне конец недели испортить.

Пишу в техподдержку хостинга, мол, коллеги, выручайте, дайте зацепку, какой из сайтов так себя предательски повел.

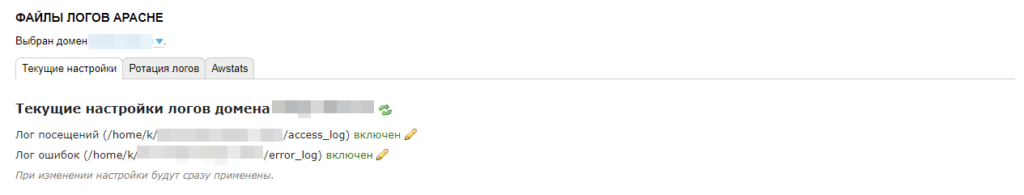

Ребята оказались отзывчивые и выслали мне домены и топ-10 айпишников, которые забрасывают своими запросами мои сайты. На мое удивление, лидером списка стали боты Яндекса, которые по непонятным мне причинам за последние два дня мне устроили атаку на мои несколько сайтов. Дополнительно решил включить логи на указанных сайтах, чтобы не дергать каждый раз тех. поддержку:

Через некоторое время, изучив логи, я сам убедился, что это точно Яндекс:

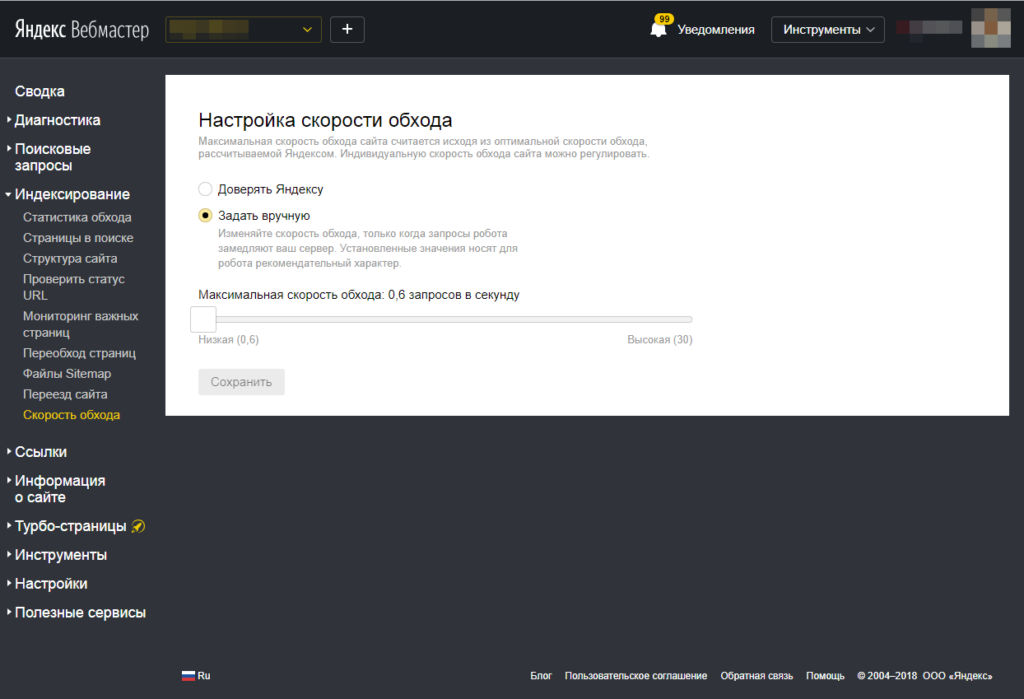

Для начала я решил прописать директиву Crowl-delay в robots.txt [?], которая позволяет задать поисковому боту минимальный период времени между окончанием загрузки одной страницы и началом загрузки следующей, но после из поста блога Яндекса я узнал, что с февраля они отказались от учета данной директивы (пруф) в пользу собственного инструмента в кабинете Яндекс.Вебмастера — ссылка на инструмент

Перейдя в раздел «Скорость обхода», я задал вручную минимальный параметр. Данную настройку я установил на всех сайтах, генерирующих нагрузку. Кроме того, на них же я установил плагин WP Cerber Security, позволяющий блокировать айпишники (подсети) после указанного количества неудачных попыток входа в админку, попытки войти с несуществующим именем пользователя, попытки запроса wp-login и устанавливающий прочие ограничения.

После выполнения указанных действий статистика в личном кабинете аккаунта хостера через день показала следующее:

Пошло снижение нагрузки после пикового значения. Какая будет тенденция дальше — буду мониторить, но уже можно с уверенностью сказать, что указанные в посте методы принесли определенные результаты. Надеюсь, что моя статья если не поможет на 100%, но хотя бы натолкнет на возможные поиски решения проблемы с нагрузкой на сервер.

Спасибо за Ваш опыт, хорошо что это работает и снижает скорость загрузки сайа. Но а как это сказалось на поисковой оптимизации, у Вас проект большой? Просто если нужно проиндексировать большой проект и быстро, то такие ограничения сильно усложнят задачу. Рассуждаю, как SEO специалист. Может быть просто у Вас слабый сервер и не совсем «правильный» хостер?

Хостер sweb.ru, на хостинге висят около 20 сайтов. Не могу отнести sweb к слабым хостерам.

По позициям сайты, которые подверглись ограничениям, я не сравнивал, ибо продвижением не занимаюсь, но чисто визуальных просадок нету. Клиент, чей сайт продвигается на стороне, но лежит на моем хосте, так же не задавал вопросы. В том числе вы нашли мой сайт, который подвергся жестким ограничениям, в поисковике)

На счет больших проектов ничего не скажу. У меня все сайты мелкие и средние.

Доброго времени суток. На самом деле, даже два десятка сайтов для большинства дешевых или средних хостингов могут создавать сильную нагрузку. Традиционно слабыми местами являются дисковая подсистема и процессор (если говорить о VPS), но это справедливо и для виртуальных хостингов, так как виртуальный аккаунт тоже расположен на каком то виртуальном сервере и ресурсы для каждого аккаунта ограничены. Если большинство хостеров для построения своей инфраструктуры используют SSD, то нагрузка на процессор становится достаточно актуальной. Например, у меня один VPS имеет два виртуальных ядра и там крутится с десяток «увесистых» сайтов, с которыми такой сервер справляется уверенно. Прошлый VPS был с одним выделенным ядром и это было печально. По идее, никакие боты поисковых систем не должны повлиять на работу сайтов, если изначально хостингу выделено достаточное количество ресурсов.

За статью все равно спасибо, возьму на заметку )

Благодарю вас за дополнительную информацию!